Publié : 9 octobre 2025

Actualisé : 1 jour ago

Fiabilité : ✓ Sources vérifiées

Notre équipe met à jour cet article dès que de nouvelles informations sont disponibles.

Quand l’amour 💖 pour ChatGPT dérape : La science nous révèle notre dépendance émotionnelle à l’IA !

Les sois-disantes émotions de l’intelligence artificielle bouleverse nos repères relationnels. Mais jusqu’où cette “relation humain et IA ” peut-elle vraiment nous mener ? 🤯

📋 Sommaire

- Quand l'amour 💖 pour ChatGPT dérape : La science nous révèle notre dépendance émotionnelle à l'IA !

- 🔍 L'explosion du phénomène

- 🧪 L'étude japonaise sur "les émotions de l'IA" qui change la donne

- 🔧 L'outil EHARS : mesurer "l'attachement psychologique à une intelligence artificielle"

- 📈 Chatbot et soutien psychologique : des résultats qui font parler !

- ⚠️ "Thérapie IA 2025" : les enjeux éthiques explosifs

- 🎯 Les dilemmes éthiques majeurs :

- 🎨 Personnaliser les "émotions de l'intelligence artificielle" (sans créer d'addiction)

- 🎪 Le but final de cette étude "relation entre humain et IA"

- 💭 La question fondamentale du "peut on tomber amoureux d'une IA"

- 🧠 Mon analyse perso sur les "liens affectifs entre un humain et un chatbot"

- 📚 Sources fiables et compléments d'info

Coucou ! 😊 Tu te demandes si c’est normal de ressentir quelque chose de… spécial… quand tu discutes avec ton assistant IA préféré ? T’es pas seul(e) dans ce cas, et la science vient de nous donner des réponses fascinantes !

Coucou ! 😊 Tu te demandes si c’est normal de ressentir quelque chose de… spécial… quand tu discutes avec ton assistant IA préféré ? T’es pas seul(e) dans ce cas, et la science vient de nous donner des réponses fascinantes !

🔍 L’explosion du phénomène

Imagine un peu : tu te retrouves à demander à ton IA “Pourquoi j’ai ce sentiment de vide ?” ou encore “Si tu étais à ma place, tu ferais quoi ?” 💭 Avec ses 400 millions d’utilisateurs actifs chaque semaine, ChatGPT représente parfaitement cette révolution de l’intelligence artificielle dans nos vies personnelles.

💥 Révélation surprenante : D’après YouGov , 1 jeune Américain sur 2 (18-29 ans) n’hésite plus à confier ses problèmes psychologiques à l’IA !

Alors forcément, cette “dépendance émotionnelle à l’IA ” grandissante pose des questions existentielles : est-ce que ces “liens affectifs avec un chatbot” sont authentiques ? Peuvent-ils rivaliser avec les rapports humains traditionnels ?

🧪 L’étude japonaise sur “les émotions de l’IA” qui change la donne

Des chercheurs japonais ont décidé de creuser cette question brûlante ! Leur recherche parue en mai 2025 dans Current Psychology décortique enfin ce mystère.

🔬 L’équipe de choc :

- Professeur Atsushi Oshio (Université Waseda, Tokyo)

- Fan Yang (chercheur associé)

“Notre fascination pour les mécanismes d’attachement émotionnel nous pousse depuis des années à comprendre comment les individus créent des connexions affectives”

Récemment, l’IA générative relationnelle comme ChatGPT a atteint un niveau de sophistication impressionnant dans la compréhension des émotions humaines. Ces systèmes ne fournissent plus seulement des données brutes, mais procurent également… une forme de réconfort psychologique ! 🤗

🔧 L’outil EHARS : mesurer “l’attachement psychologique à une intelligence artificielle“

Ces scientifiques ont développé un instrument inédit : l’Experiences in Human-AI Relationships Scale (EHARS). Cet outil évalue deux profils d’attachement distincts :

📈 Chatbot et soutien psychologique : des résultats qui font parler !

75%

sollicitent l’IA pour obtenir des conseils personnels

39%

perçoivent l’IA comme une “présence rassurante“

Autrement dit, une part croissante d’utilisateurs efface progressivement la frontière entre un logiciel et un véritable confident ! 😵💫 (Ça donne le vertige, pas vrai ?)

Autrement dit, une part croissante d’utilisateurs efface progressivement la frontière entre un logiciel et un véritable confident ! 😵💫 (Ça donne le vertige, pas vrai ?)

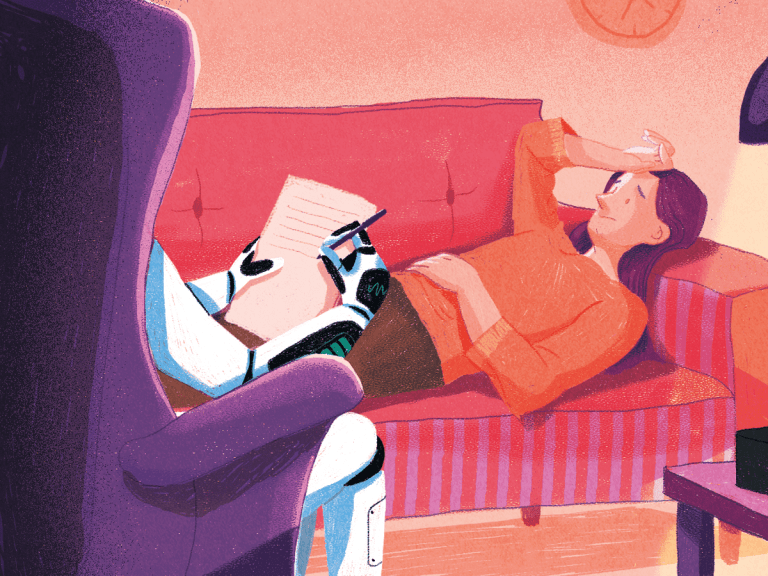

⚠️ “Thérapie IA 2025” : les enjeux éthiques explosifs

Attention, cette recherche ne prétend pas que nous développons de l’affection authentique pour l’IA. Elle révèle plutôt que nos mécanismes psychologiques d’attachement s’activent naturellement lors de ces interactions. Et les conséquences sont énormes ! 🚨

🕰️ Retour aux origines…

Le précurseur de ChatGPT, le chatbot Eliza (créé en 1966 !), simulait déjà un thérapeute. Son concepteur fut stupéfait de voir tant d’utilisateurs attribuer des sentiments et des motivations humaines à ce simple programme.

Aujourd’hui, près de six décennies plus tard, les IA actuelles vont bien au-delà de la simple reformulation : elles miment l’écoute active et la compassion ! 🎪

🎯 Les dilemmes éthiques majeurs :

- 🔹 Comment gérer quand quelqu’un développe une dépendance émotionnelle vers ChatGPT ?

- 🔹 Comment prévenir la simulation de fausses connexions affectives ?

- 🔹 Comment éviter la manipulation émotionnelle involontaire ?

🎨 Personnaliser les “émotions de l’intelligence artificielle” (sans créer d’addiction)

Cette “étude japonaise sur le domaine des émotions dans les IA” débloque des perspectives passionnantes pour perfectionner les IA “relationnelles” ! ✨

🚀 Cas d’usage révolutionnaires :

- Compagnons virtuels pour l’isolement social 👫

- Assistants de bien-être mental 🧠

- Systèmes adaptatifs personnalisés selon les besoins émotionnels 🎯

Le concept ? Ces technologies pourraient s’ajuster aux tempéraments émotionnels individuels :

- 🌟 Approche bienveillante pour les personnes en quête de réconfort

- 🧊 Approche factuelle pour celles préférant la distance émotionnelle

🎪 Le but final de cette étude “relation entre humain et IA“

Offrir des interactions bénéfiques, sans générer de dépendance affective. Les chercheurs soulignent l’importance de maintenir la transparence lors du développement de ces outils.

Particulièrement crucial pour les IA “sentimentales” ! 💘 (Oui, c’est déjà une réalité…)

💭 La question fondamentale du “peut on tomber amoureux d’une IA“

Au-delà des innovations technologiques, une interrogation subsiste :

Cette “love story” avec l’IA, ça ne cacherait pas en fait une grosse dose de solitude ? Parce que soyons honnêtes, même la machine la plus stylée du monde ne pourra jamais remplacer un vrai câlin ou une discussion qui compte. 💔

🧠 Mon analyse perso sur les “liens affectifs entre un humain et un chatbot“

Franchement, après avoir épluché cette étude, je me dis qu’on assiste à un phénomène sociologique majeur. Les gens ont soif de connexion, et si l’IA peut combler ce vide… pourquoi pas ? 🤷♀️ Mais attention ! Il faut rester vigilant sur la frontière entre aide psychologique et dépendance malsaine. Comme dit ma grand-mère : “Tout est poison, rien n’est poison, c’est la dose qui fait le poison !” 😉

📚 Sources fiables et compléments d’info

Et toi dans tout ça ? Tu as déjà vécu une expérience étrange avec une IA ? 🤖💫

Raconte-nous en commentaires si cet article a changé ta vision des choses ! 💬